正直に言いますね。

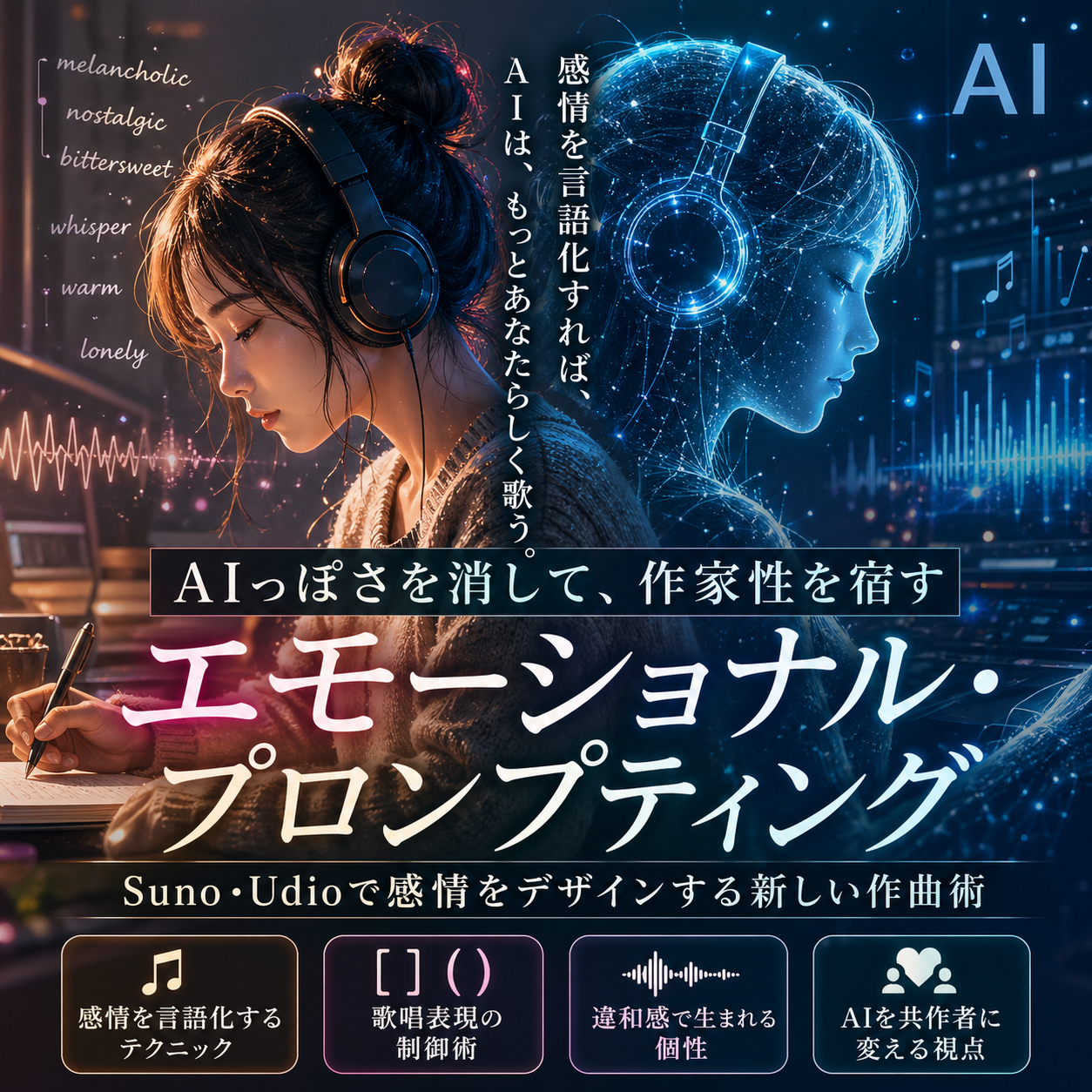

「AIで作った作品って、どこか似てる」と感じたことはありませんか?

私も何度もそう思ってきました。

ちゃんとプロンプトを書いているのに、どこか“それっぽいだけ”で終わってしまうあの感覚です。

便利なのに、なぜか心に残らない。

完成しているのに、どこか足りない。

その違和感の正体は、とてもシンプルです。

AIに「情報」は渡していても、「感情」は渡していなかったからです。

ジャンルやテンポ、雰囲気だけでは、AIは“平均点の作品”を返してきます。

でも、あなたが本当に作りたいのは、そんな無難なものではないはずです。

もっと、自分の内側にあるもの。

言葉にしきれない温度や、曖昧な揺らぎや、少しの歪み。

そういうものを、ちゃんと作品に乗せたいと思っているはずです。

だからこそ今、必要なのが「エモーショナル・プロンプティング」です。

これはテクニックの話ではありません。

AIに命令するのではなく、自分の感情をどう渡すかという考え方そのものです。

私はこの方法に切り替えてから、明らかに生成結果が変わりました。

「AIっぽい」から、「自分っぽい」へと変わった瞬間です。

この記事では、その変化を生み出すための具体的な考え方と実践方法を、余すことなくお伝えします。

AIをただの道具で終わらせるか、それとも“相棒”にするか。

その分かれ道を、ここで一緒に越えていきましょう。

AI共創時代に求められる「エモーショナル・プロンプティング」とは

AIで作品を作ること自体は、もう特別なことではなくなりましたよね。

誰でも、ある程度“それっぽいもの”は作れてしまう時代です。

だからこそ今、はっきりと差が出始めています。

「何を作るか」ではなく、「どう感情を込めるか」で結果が変わる時代に入っています。

ここで鍵になるのが、エモーショナル・プロンプティングです。

これは単なるテクニックではなく、AIとの関係性そのものを変えるアプローチです。

なぜ今、ジャンル指定だけでは通用しなくなったのか

少し前までは、「lofi」「city pop」「epic」などのジャンル指定だけで十分でした。

それでも、それなりにクオリティの高いものが出てきたからです。

ですが今は違います。

同じようなプロンプトが増えすぎたことで、出力も似通ってきています。

結果として、多くの作品が“どこかで聴いたことがある音”になってしまうんです。

ジャンル指定は「方向」を決めるだけで、「個性」までは作ってくれません。

ジャンル指定の限界

| 指定内容 | 得られるもの | 不足するもの |

| lofi / chill | 雰囲気・テンポ感 | 感情の深度・物語性 |

| J-pop / ballad | 構成・メロディ傾向 | 歌い手のニュアンス |

| epic / cinematic | スケール感 | 繊細な揺らぎ・人間味 |

つまり、ジャンルだけでは“骨格”しか作れないんです。

そこに血を通わせるには、別の要素が必要になります。

AI生成の差を生むのは「感情の解像度」

では、その差はどこで生まれるのか。

答えはシンプルです。

どれだけ細かく「感情」を言葉にできているかです。

たとえば「悲しい曲」と書くのと、次のように書くのでは結果がまったく変わります。

感情の解像度の違い

- 低解像度:悲しい、切ない

- 高解像度:言葉にできない後悔を抱えながら、静かに夜をやり過ごすような感情

後者のほうが、圧倒的に“空気”が伝わりますよね。

AIはこの“空気”をヒントにして、音や構成を選び始めます。

だから結果として、より人間らしいアウトプットになるんです。

AIを“道具”から“共作者”へ変える発想転換

ここで一つ、視点を変えてみてほしいんです。

あなたは今、AIに何をしていますか?

命令していますか、それとも会話していますか。

この違いは、想像以上に大きいです。

AIは命令されると最適解を出しますが、共鳴すると“解釈”を始めます。

そしてこの“解釈”こそが、作家性を生むポイントです。

関係性の違い

| 使い方 | 結果 |

| 道具として使う | 正確だが無難な作品 |

| 共作者として向き合う | 揺らぎや個性を含んだ作品 |

エモーショナル・プロンプティングは、後者の状態を意図的に作るための方法です。

つまり、AIに正解を出させるのではなく、一緒に“答えを探す”状態に持ち込むということです。

ここを理解できると、生成結果が一気に変わり始めます。

そしてその変化は、もう“偶然”ではなくなります。

なぜあなたのAI作品は「無機質」に感じられるのか

ここまで読んで、「たしかに」と感じているかもしれません。

でも同時に、こうも思っていませんか?

「ちゃんとプロンプトは書いているのに、なぜか心に残らない」と。

その原因は、才能ではありません。

ほとんどの場合、“無機質になる構造”に無意識でハマっているだけです。

ここでは、その正体を一つずつほどいていきます。

ジャンル指定が引き起こす“平均化の罠”

AIはとても優秀です。

だからこそ、与えられた情報から“最適解”を出そうとします。

そしてジャンル指定というのは、まさにその“最適解”を引き出すトリガーなんです。

たとえば「lofi」と書けば、AIはこう考えます。

「多くの人が好むlofiとは何か?」と。

結果として出てくるのは、完成度は高いけれど、どこかで聴いたような音になります。

つまりジャンル指定は、“成功パターンの再現”であって、“個性の創出”ではないんです。

平均化が起きるプロンプトの特徴

- 単語だけで構成されている(lofi, chill, emotional など)

- 具体的な情景やストーリーがない

- 誰の視点なのかが曖昧

- 感情が一言で終わっている

この状態だと、AIは「安全で外さない答え」を選び続けます。

そしてそれが、“AIっぽさ”の正体になります。

AIが選ぶ「安全な表現」とその限界

AIは基本的に、“外さないこと”を優先します。

なぜなら、極端な表現や破綻した構成は、多くのユーザーにとって不快になる可能性があるからです。

そのため、プロンプトが曖昧なほど、出力はどんどん無難になります。

たとえば、こういう状態です。

安全な表現に寄った例

- 綺麗にまとまっているが印象に残らない

- メロディは良いが感情の起伏が弱い

- どこかで聴いたことがあるように感じる

これは失敗ではありません。

むしろ“成功しすぎている”状態なんです。

整いすぎているからこそ、心に引っかからないんです。

感情が欠落したプロンプトの共通点

では、どんなプロンプトが“無機質さ”を生むのか。

共通点ははっきりしています。

「説明」はあるのに、「体験」がないことです。

よくあるNG構造

| 要素 | NG例 | なぜ弱いか |

| 感情 | 悲しい曲 | 解釈の幅が広すぎる |

| 雰囲気 | エモい雰囲気 | 抽象的で具体性がない |

| 構成 | サビを盛り上げる | どう盛り上げるかが不明 |

これらはすべて「情報」としては正しいです。

ですが、“感情の温度”が乗っていません。

だからAIも、それ以上のものを返せないんです。

本質的な違い

- 情報:分類・説明・整理されたもの

- 感情:揺らぎ・矛盾・未完成なもの

AIが人間らしく見える瞬間は、後者に触れたときです。

そしてそれを引き出せるかどうかは、プロンプト次第です。

ここまでで、「なぜ無機質になるのか」は見えてきたはずです。

では次に進みましょう。

どうすれば“感情が宿るプロンプト”を書けるのか。

ここからが本題です。

エモーショナル・プロンプティングの基本原則

ここからが、本当に重要なパートです。

テクニックの前に、まず“考え方”を整えましょう。

なぜなら、表面的な書き方だけ変えても、結果はほとんど変わらないからです。

エモーショナル・プロンプティングは、「何を書くか」ではなく「どう捉えるか」で決まります。

この章では、その土台になる3つの原則をお伝えします。

「状態」ではなく「感情のプロセス」を書く

多くの人がやってしまうのが、「状態」で止まってしまう書き方です。

たとえば「悲しい」「嬉しい」といった単語です。

これは間違いではありませんが、圧倒的に情報が足りません。

なぜなら、人間の感情は“変化”するものだからです。

重要なのは「今どうか」ではなく、「どう揺れているか」です。

状態とプロセスの違い

| 書き方 | 例 | 出力の傾向 |

| 状態 | 悲しい曲 | 平坦で無難 |

| プロセス | 諦めきれずに、少しずつ感情が沈んでいく | 展開と奥行きが生まれる |

プロセスを書くことで、AIは“変化”を表現しようとします。

それが、メロディや構成の自然な起伏につながるんです。

五感と言葉の温度を組み込む

次に意識してほしいのが、「五感」です。

音楽なのに五感?と思うかもしれませんが、ここが分かれ道です。

人間は、感情をそのまま言葉にするよりも、感覚を通して表現します。

だからこそ、“感じられる言葉”があるだけで、出力は一気に変わります。

五感の取り入れ方

- 視覚:薄暗い部屋、滲む街灯、揺れる影

- 聴覚:遠くで鳴る音、かすれた声、途切れるリズム

- 触覚:冷たい空気、乾いた手、重い沈黙

- 時間感覚:ゆっくり崩れる、止まりかける、引きずるように進む

これらはすべて、音楽の要素に変換されます。

テンポ、音数、音色、間の取り方として反映されるんです。

あえて「違和感」を設計する

ここが一番重要で、そして一番見落とされがちなポイントです。

それが「違和感」です。

普通に考えれば、違和感は避けるものですよね。

でも、創作においては逆です。

違和感こそが、“その人らしさ”を生む核になります。

違和感の具体例

- 明るいメロディなのに、歌詞は崩壊寸前の内容

- 静かな構成の中に、突然ノイズ的な要素を入れる

- 優しい声で、冷たい言葉を歌わせる

これらはすべて、“ズレ”を意図的に作っています。

そしてこのズレが、聴いた人の記憶に残ります。

理論からズラすことで生まれる個性

音楽理論はとても重要です。

ですが、それだけでは“綺麗すぎる”結果になりやすいです。

だからこそ、ほんの少しだけ外すんです。

完璧にしない勇気が、結果的に一番人間らしい表現を生みます。

ここまでの3つをまとめます。

- 感情は「状態」ではなく「変化」で書く

- 五感を使って“感じられる言葉”にする

- あえて違和感を入れて個性を作る

この土台ができると、プロンプトの精度は一気に上がります。

そして何より、生成結果に“体温”が宿り始めます。

次の章では、これを実際のプロンプトにどう落とし込むかを見ていきましょう。

実践テクニック①:情緒を言語化するプロンプト設計

ここまで読んで、「考え方は分かった」と感じているかもしれません。

でも実際に手を動かすと、こうなりがちです。

「結局、どう書けばいいのか分からない」と。

その状態、とても自然です。

だからここでは、“そのまま使えるレベル”まで具体化していきます。

難しいことはしません。

ただ、「言葉の精度」を一段上げるだけです。

NG例と改善例の比較

まずは、一番分かりやすい形で見てみましょう。

同じテーマでも、書き方だけで結果がどう変わるかです。

NG:ジャンルだけの指示

- J-pop, emotional, ballad

- lofi, chill, sad

- piano, slow, beautiful

これでも音は出ます。

むしろ、かなり“それっぽい”ものが出てきます。

ですが問題はここです。

「誰の、どんな感情なのか」が完全に抜けています。

OK:情景・感情・ニュアンスを含めた文章

- 夜が明けきらない部屋で、言葉にできない後悔を抱えたまま静かに始まるピアノバラード

- もう戻れない関係を理解しながらも、どこかで期待してしまう感情を含んだローファイサウンド

- 優しく歌っているのに、どこか諦めが滲むようなボーカルのスローテンポな楽曲

どうでしょうか。

頭の中に、すでに“音”が浮かびませんか?

AIも同じです。

具体的な情景と言葉の温度があるだけで、出力の方向が一気に絞られます。

「曖昧さ」をあえて残すテクニック

ここで一つ、意外なポイントをお伝えします。

それは「全部を決めすぎないこと」です。

完璧に説明しようとすると、逆に硬くなります。

そして、AIも“説明通りの無難な答え”を出してきます。

あえて余白を残すことで、AIの解釈が入り、結果に“揺らぎ”が生まれます。

曖昧さの入れ方

- 「少し」「どこか」「かすかに」などの曖昧表現を入れる

- 感情を断定せず、揺れている状態で止める

- 結論を書かず、途中の状態で終える

これは、人間の感情そのものですよね。

だからこそ、リアルになります。

ストーリーを一行で埋め込む方法

もう一つ、非常に強力なテクニックがあります。

それが「一行ストーリー」です。

長い物語は必要ありません。

ほんの一文で十分です。

“状況+感情”をセットで書くだけで、作品に軸が生まれます。

一行ストーリーの例

- 別れを決めた夜に、それでも最後の言葉を探している瞬間

- 夢を諦めた帰り道で、なぜか少しだけ前を向いている感情

- もう会えないと分かっているのに、連絡を待ってしまう時間

この一文があるだけで、AIは“何を表現すべきか”を理解し始めます。

そして、その理解が音に変わります。

ここまでできれば、もう大きく外すことはありません。

むしろ、毎回違う表情の作品が出てくるようになります。

それはもう、「生成」ではなく「共創」に近い状態です。

次の章では、さらに踏み込みます。

[ ]や( )を使って、歌唱や演出をどこまでコントロールできるのか。

ここを理解すると、表現の幅が一気に広がります。

実践テクニック②:[ ]と( )で歌唱・演出をコントロールする

ここから一気に“プロの領域”に入ります。

正直、このテクニックを知っているかどうかで、出力の完成度は別物になります。

それが、[ ]と( )の使い分けです。

この2つはただの記号ではなく、「演出指示」と「感情の内側」を分けるスイッチです。

感覚としては、外側と内側を同時に設計できるようになります。

[ ]:構造・演出・セクション指示の使い方

まずは[ ]からです。

これは主に、「楽曲の構造」と「演出」をコントロールする役割を持ちます。

いわば、ステージの設計図です。

基本的な使い方

- [Intro]

- [Verse]

- [Chorus]

- [Bridge]

ここまではよく使われていますよね。

ですが、本当に重要なのはここからです。

感情・演出を組み込む応用

- [Verse: whispered vocals, minimal piano]

- [Chorus: emotional peak, full arrangement]

- [Bridge: sudden silence, fragile voice]

このように書くことで、セクションごとに“演出の温度”を変えることができます。

つまり、曲の中にドラマを仕込めるようになるんです。

セクションごとに感情を変化させる方法

| セクション | 役割 | 感情の方向 |

| Intro | 世界観の提示 | 抑えめ・余白 |

| Verse | 状況説明 | 揺らぎ・迷い |

| Chorus | 感情の解放 | ピーク・本音 |

| Bridge | 転換 | 崩壊・静寂・違和感 |

この流れを意識するだけで、単なるループ音楽から一気に“物語のある楽曲”に変わります。

( ):歌唱ニュアンス・内面表現のコントロール

次に( )です。

こちらは[ ]とは真逆の役割を持ちます。

構造ではなく、「内側」です。

( )は、声の温度や感情の揺れを直接コントロールします。

基本的な使い方

- (whispering)

- (softly)

- (hesitating)

- (almost crying)

これらを歌詞の中に差し込むことで、同じフレーズでもまったく違う印象になります。

感情の細分化例

- (trying not to cry)

- (forcing a smile)

- (voice slightly shaking)

- (barely audible)

ここまで細かく指定すると、AIは“ただ歌う”のではなく、“演じる”ようになります。

この違いが、無機質さを消す決定打になります。

[ ]と( )を組み合わせた応用テクニック

そして最後に、この2つを組み合わせます。

ここまで来ると、ほぼディレクションです。

組み合わせ例

- [Verse: minimal piano] (hesitating) I still remember your voice

- [Chorus: emotional peak] (almost shouting) I don’t want to let go

- [Bridge: silence] (whispering) was it all my fault?

どうでしょうか。

文章だけなのに、すでに“演出”が見えますよね。

AIも同じように解釈します。

使い分けの本質

| 記号 | 役割 | イメージ |

| [ ] | 外側(構造・演出) | ステージ・照明・構成 |

| ( ) | 内側(感情・ニュアンス) | 役者の演技・呼吸・心情 |

この2層を同時に設計できた瞬間、AIの出力は“作品”に変わります。

ここまでできれば、もう「AIっぽい」と言われることはほとんどなくなります。

むしろ、「どうやって作ったの?」と聞かれる側になります。

次の章ではさらに踏み込みます。

あえて“壊す”ことで個性を出す、違和感の入れ方です。

ここを理解すると、一気に突き抜けます。

NG版 vs 覚醒版:「Last Love」を聴き比べると何が違うのか

ここまで理論やテクニックを見てきましたが、一番伝わるのはやっぱり“比較”です。

今回は、同じタイトル・同じ歌詞で作った2曲を並べてみます。

違うのは、プロンプトの“感情の入れ方”だけです。

それだけで、ここまで変わるのかと感じてもらえるはずです。

実際の生成音源

まずは、実際に生成した音源を聴き比べてみてください。

- [NG版]:Last Love (通常版)suno

- [覚醒版]:Last Love(覚醒版)suno

同じ歌詞とは思えないほど印象が変わるはずです。

比較①:プロンプト設計の違い

まずは土台となる設計の違いです。

| 項目 | NG版 | 覚醒版 |

| 感情表現 | emotional, sad | fragile, trembling, unresolved feelings |

| ボーカル指定 | clean vocals | breathy, voice cracks, imperfect expression |

| 構成 | シンプル構成 | 緊張→抑制→解放の流れを設計 |

| 空間・演出 | なし | silence, tension, room reverb など細かく指定 |

NG版は「説明」です。

覚醒版は「体験」を設計しています。

この違いが、そのまま“聴いたときの差”になります。

比較②:歌詞の見え方の違い

歌詞自体は一切変えていません。

それでも印象は大きく変わります。

NG版の印象

- どこかで聴いたことがある

- 綺麗だけど引っかからない

- 感情が均一で起伏が弱い

覚醒版の印象

- 同じ言葉なのに“重さ”が違う

- 声に揺らぎがあり人間らしい

- 一つ一つのフレーズに意味が生まれる

言葉ではなく、「どう発せられるか」で作品は変わります。

比較③:リスナー体験の違い

最も大きな違いはここです。

“音”ではなく、“体験”としてどう感じるか。

| 視点 | NG版 | 覚醒版 |

| 聴きやすさ | 高い | やや揺らぎあり |

| 印象 | 無難 | 引っかかる |

| 記憶への残り方 | 薄い | 強い |

| 感情移入 | しにくい | しやすい |

NG版は“BGM”として優秀です。

でも覚醒版は違います。

リスナーの感情を動かしにいく「作品」になっています。

なぜここまで差が出るのか

理由はとてもシンプルです。

AIが受け取っている情報の質が違うからです。

本質的な違い

- NG版:ジャンルと雰囲気の指示

- 覚醒版:感情・演出・揺らぎの設計

AIは優秀です。

だからこそ、渡された情報以上のものは出せません。

あなたがどこまで細かく“感情”を渡せるかで、作品の深度は決まります。

この比較から得てほしいこと

ここで覚えてほしいのは、難しいテクニックではありません。

もっとシンプルなことです。

- 同じ素材でも結果は変わる

- 差を生むのは“感情の設計”

- AIはそれを忠実に拡張する

つまり、作品の本質は「プロンプトの中にすでにある」ということです。

この感覚が掴めたら、もう大丈夫です。

あとは、自分の言葉で試すだけです。

そこから先は、あなたの表現になります。

実践テクニック③:「AIっぽさ」を壊す違和感の入れ方

ここまで来たあなたなら、もう気づいているはずです。

整えるだけでは、限界があるということに。

どれだけ丁寧に作っても、“綺麗なだけの作品”で止まってしまう瞬間があります。

その壁を壊すのが、「違和感」です。

少し怖いかもしれませんが、ここを越えた瞬間に作品の印象は一気に変わります。

あえて不完全な指示を入れる理由

普通は、完璧に指示しようとしますよね。

ミスが出ないように、ズレが起きないように。

でもAIにおいては、それが逆効果になることがあります。

完璧な指示は、完璧すぎる“予定調和”を生みます。

不完全さを意図的に入れる例

- あえて曖昧な表現を残す(例:「少しズレたリズム」)

- 説明しきらない感情で止める

- 構成を途中で崩す可能性を示唆する

こうすることで、AIは“補完”しようとします。

そしてその補完こそが、人間らしい揺らぎになります。

感情の矛盾を混ぜるテクニック

人間の感情は、実はかなり矛盾しています。

嬉しいのに寂しい。

離れたいのに、離れたくない。

この“矛盾”を入れるだけで、作品は一気に深くなります。

単一の感情よりも、相反する感情のほうがリアルなんです。

矛盾の入れ方

- 明るいサウンド × 重いテーマ

- 優しい声 × 冷たい言葉

- 穏やかな構成 × 内面の混乱

このズレが、“あれ?”という引っかかりを生みます。

そしてその引っかかりが、記憶に残ります。

リズム・構成を“崩す”ことで生まれるリアリティ

もう一歩踏み込みましょう。

音楽は本来、整っているものです。

だからこそ、少し崩すだけで強烈な印象になります。

違和感はノイズではなく、“意味のあるズレ”として設計できます。

崩し方の具体例

- サビ直前で一瞬の無音を入れる

- テンポ感を微妙に揺らすよう指示する

- 繰り返しの中に一箇所だけ違うフレーズを混ぜる

こうした要素は、人間の演奏では自然に起こります。

でもAIは指示しないと基本的にやりません。

だからこそ、意図的に入れる価値があります。

違和感設計のビフォーアフター

| 状態 | 特徴 |

| 違和感なし | 完成度は高いが印象が薄い |

| 違和感あり | 引っかかりがあり記憶に残る |

ここで大事なのは、やりすぎないことです。

すべてを崩す必要はありません。

“一箇所だけズラす”くらいが、最も効果的です。

この違和感を扱えるようになると、作品に「癖」が生まれます。

そしてその癖こそが、「あなたらしさ」になります。

次の章では、このすべてを実践に落とし込むための流れをお伝えします。

AIとどう向き合い、どう育てていくのか。

ここが分かると、制作そのものが変わります。

AIと共創するためのワークフロー

ここまで読んできたあなたは、もう気づいているはずです。

良いプロンプトは「一発で当てるもの」ではないということに。

むしろ逆です。

本当に良い作品は、何度も対話しながら“育てていくもの”です。

この章では、そのための実践的な流れをお伝えします。

一発で決めない:反復生成の重要性

まず大前提として持っておいてほしい考え方があります。

それは「1回で完璧を目指さないこと」です。

AI生成には必ず“揺らぎ”があります。

同じプロンプトでも、微妙に違う結果が出ますよね。

それは欠点ではなく、むしろ最大の強みです。

この揺らぎを使いこなせるかどうかが、クオリティの分かれ道になります。

基本フロー

- ① プロンプトを書く

- ② 生成する

- ③ 違和感・良かった点を言語化する

- ④ プロンプトを微調整する

- ⑤ 再生成する

シンプルですが、これが最も再現性の高いやり方です。

一発勝負ではなく、少しずつ“寄せていく”イメージです。

プロンプトを育てるという考え方

ここで視点を変えてみてください。

プロンプトは「書いて終わり」ではありません。

むしろスタート地点です。

プロンプトは、試行錯誤の中で“進化するもの”です。

育てるプロンプトの特徴

- 毎回少しだけ変えている

- 良かった要素を残している

- 違和感を修正している

- 意図を少しずつ明確にしている

この積み重ねによって、プロンプトはどんどん精度が上がります。

そして最終的には、「自分だけの型」になります。

“偶然”を味方にするクリエイティブ思考

最後に、最も重要な感覚をお伝えします。

それは「偶然を歓迎すること」です。

生成していると、たまに予想外の結果が出ますよね。

最初は「失敗」と感じるかもしれません。

でも、その中に“当たり”が混ざっています。

意図していない良さこそ、AI共創の醍醐味です。

偶然を活かすポイント

- 違和感をすぐ捨てない

- 「なぜ良いか」を考える

- その要素を次のプロンプトに残す

これを繰り返していくと、作品の質が一段上がります。

そして気づいたときには、AIが“予測できない良さ”を持ち始めます。

ここまでできれば、もう十分です。

あなたはすでに、AIをただのツールとしてではなく、共に作る存在として扱えています。

次はいよいよまとめです。

AIを相棒にするために、最後に押さえておくべき視点を整理しましょう。

まとめ:AIはあなたの感性を拡張する「相棒」になる

ここまで読み進めてきたあなたは、もう最初の頃とは違う視点を持っているはずです。

AIに対しての向き合い方が、少し変わってきていませんか?

もしそうなら、それはとても良い変化です。

AIは“使うもの”ではなく、“引き出すもの”だと気づき始めている証拠だからです。

プロンプトは命令ではなく対話である

これが、このテーマの本質です。

これまでのように「こうして」と指示するだけでは、限界があります。

なぜなら、それはAIの可能性を狭めてしまうからです。

プロンプトは命令ではなく、“解釈のきっかけ”です。

あなたの言葉がヒントになり、AIがそこから広げていく。

この関係性が生まれたとき、作品は一気に変わります。

あなたの「言葉」が作品の深度を決める

結局のところ、すべてはここに集約されます。

どんなツールを使うかよりも、どんな言葉を渡すか。

ここに、すべての差が出ます。

言葉の解像度が、そのまま作品の解像度になります。

今日から意識してほしいポイント

- 感情を一言で終わらせない

- 情景や温度を必ず入れる

- 違和感を恐れず、少しだけズラす

- 一発で決めようとしない

これだけで、出力は確実に変わります。

次に試してほしいアクション

ここまで読んで終わりにするのは、もったいないです。

ぜひ、今すぐ試してみてください。

難しいことは必要ありません。

たった一つ、プロンプトを書き直すだけでいいんです。

シンプルな実践ステップ

- いつものプロンプトを1つ用意する

- そこに「感情のプロセス」を追加する

- さらに「一行ストーリー」を入れる

- 最後に「少しの違和感」を加える

それだけで、結果は驚くほど変わります。

もし変わらなかったとしても、それもヒントです。

その違和感を、次に活かせばいいだけです。

AIとの創作に、正解はありません。

だからこそ、面白いんです。

あなたの感性が、そのまま作品になる時代です。

その可能性を、ぜひ使い切ってください。

よくある質問(FAQ)

ここでは、実際に多くの人がつまずきやすいポイントをまとめました。

細かい疑問を解消することで、理解が一気に深まります。

Q1:エモーショナル・プロンプティングは長く書かないとダメですか?

結論から言うと、長さは本質ではありません。

重要なのは「情報量」ではなく「解像度」です。

短くても、感情や状況が具体的であれば十分に伝わります。

むしろ、無駄に長いだけのプロンプトは逆効果になることもあります。

Q2:英語と日本語、どちらで書くべきですか?

これはツールによって多少変わりますが、基本的には英語が安定しやすいです。

特にSunoやUdioは英語データが多いため、ニュアンスが伝わりやすい傾向があります。

ただし重要なのは言語ではなく、「どれだけ具体的に感情を表現できているか」です。

日本語でも十分に良い結果は出せます。

Q3:[ ]や( )は必ず使うべきですか?

必須ではありません。

ですが、使えると表現の幅が一気に広がります。

特に「演出」と「歌唱ニュアンス」を分けて考えたい場合には非常に有効です。

最初はシンプルなプロンプトで慣れてから、徐々に取り入れるのがおすすめです。

Q4:思った通りの結果が出ない場合はどうすればいいですか?

まず前提として、完全に狙い通りの結果が一発で出ることはほとんどありません。

それがAI生成の特徴です。

大切なのは「どこがズレたか」を言語化して、次に活かすことです。

改善のヒント

- 感情が抽象的すぎないか確認する

- 情景や状況が不足していないか見直す

- 不要な要素を削ってシンプルにする

Q5:毎回クオリティにバラつきがあるのはなぜですか?

これは仕様です。

AIは確率的に出力を生成するため、同じプロンプトでも結果が変わります。

この“揺らぎ”こそが、AI共創の価値でもあります。

安定させたい場合は、プロンプトの精度を上げつつ、複数回生成して選ぶのが基本になります。

Q6:初心者でもエモーショナル・プロンプティングは使えますか?

むしろ初心者にこそおすすめです。

音楽理論や専門知識がなくても、「感情」を軸にすれば作品を作れるからです。

難しい知識よりも、「どう感じているか」を言葉にすることのほうが重要です。

Q7:AIっぽさを完全に消すことはできますか?

完全にゼロにするのは難しいです。

ですが、かなり目立たなくすることは可能です。

その鍵が「感情」「違和感」「揺らぎ」の3つです。

これらを意識するだけで、印象は大きく変わります。

ここまで読んでいただき、ありがとうございました。

もし一つでも「試してみよう」と思えたなら、それが一番の収穫です。

ぜひあなた自身の言葉で、AIとの共創を楽しんでみてください。

参考リンク

この記事の作成にあたり、以下の公式情報・研究資料を参照しました。

リンク先が確認できたもののみ掲載しています。

- Suno 公式サイト

- Suno Help Center

- Suno Help Center / Create in V4.5: Detailed Style Instructions

- Suno Help Center / Create in V4.5: Better Prompts in Lyrics

- Suno Help Center / Music Glossary for Suno

- Suno Help Center / How to Use: Song Editor

- Suno Help Center / Do I have the copyrights to songs I made?

- Udio 公式サイト

- Udio Help Center / Prompt Like a Master

- Udio Help Center / Level up your creations with guidance tags

- Udio Help Center / The Brick Method: Making Udio Work for You

- arXiv / Data-Driven Analysis of Text-Conditioned AI-Generated Music: A Case Study with Suno and Udio

- arXiv / Long-Form Text-to-Music Generation with Adaptive Prompts